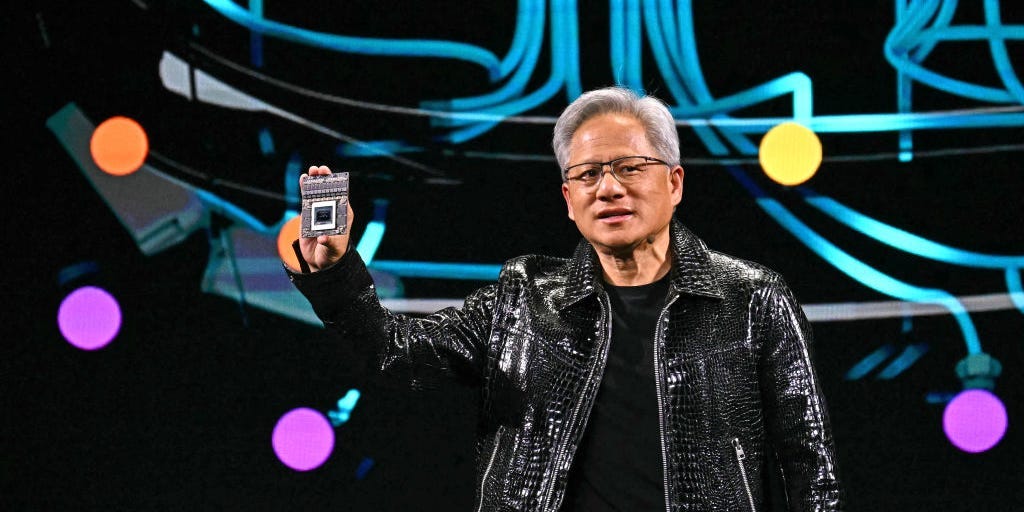

Le PDG de Nvidia dit que les modèles d’IA comme R1 de Deepseek ont besoin de 100 fois plus de calcul

Les modèles d’IA ont encore plus faim d’énergie informatique, a déclaré le PDG de Nvidia, Jensen Huang, a déclaré mercredi soir l’appel de résultats de mercredi soir.

La société a battu même les attentes des revenus haut de gamme, mais les investisseurs ont affiché une réponse tiède. Étant donné que Deepseek a lancé ses modèles open source étrangement efficaces le mois dernier, la plus grande question qui se profile pour Nvidia était si les modèles efficacement formés de l’entreprise chinoise réduisent la demande de calcul de l’IA.

Étant donné que le modèle le plus percutant de Deepseek, R1, était un modèle de raisonnement, la réponse de Huang était un «non» catégorique.

« Les modèles de raisonnement peuvent consommer 100x plus de calcul. Le raisonnement futur peut consommer beaucoup plus de calcul », a-t-il déclaré lors de l’appel.

Huang a qualifié Deepseek une « excellente innovation ».

« Mais plus important encore, il a un modèle d’IA de raisonnement d’IA de classe mondiale. Presque tous les développeurs d’IA appliquent R1, ou chaîne de pensées et de techniques d’apprentissage de renforcement comme R1 pour mettre à l’échelle les performances de leur modèle », a déclaré Huang mercredi.

Huang avait abordé le cours des actions de Nvidia dans une interview diffusée la semaine dernière, affirmant que les investisseurs avaient mal interprété le phénomène Deepseek.

Les fournisseurs de cloud ont également déclaré à BI que la demande de jetons les plus puissants de Nvidia continuerait de croître.

L’impact durable de Deepseek a été la poussée vers « les modèles de raisonnement à forte intensité de ressources », a déclaré Dan Morgan, analyste de Synovus, dans une note d’investisseurs, se référant à des ressources telles que les puces et la puissance pour l’inférence – le type de calcul de l’IA qui affine les modèles et génère des réponses de raisonnement et de requête.

La compétition augmente

L’inférence a augmenté lentement à mesure que les applications d’IA mûrissent.

« La grande majorité de notre calcul aujourd’hui est en fait une inférence, et Blackwell porte tout cela à un nouveau niveau », a déclaré Huang mercredi, faisant référence à la nouvelle génération de puces de l’entreprise.

Bien que Nvidia conserve toujours la plus grande part de tous les marchés de calcul de l’IA, les analystes commencent à voir un monde où cela est moins certain.

« La concurrence commence à faire des ravages sur la position de Nvidia, bien qu’elle ne soit pas très importante à ce stade », a déclaré l’analyste de Third Bridge, Lucas Keh, après l’appel de résultats de Nvidia.

Les challengers de Nvidia ont ciblé l’inférence depuis des années, car il devrait être un marché plus important à long terme. En effet, ces derniers mois, de nouvelles sociétés de puces d’inférence ont augmenté en nombre et en soutien. La startup de puce Tenstorrent a annoncé près de 700 millions de dollars et gravé a annoncé 120 millions de dollars de financement frais l’année dernière.

De plus, les investisseurs sont de plus en plus préoccupés par le fait que les puces d’IA personnalisées que les sociétés cloud comme Google et Amazon ont commandées puissent éloigner l’exemple de Nvidia, en particulier dans l’inférence.

« Nous avons entendu dire que leur part de marché dans l’inférence pourrait baisser à 50% à mesure que le paysage se développe », a déclaré Keh à BI par e-mail.

Nvidia a refusé de commenter.