Deepseek stimule la demande pour les puces H200 de Nvidia, disent certaines entreprises cloud

Certains fournisseurs de cloud connaissent une augmentation notable de la demande de puces H200 de Nvidia après que la société de l’IA chinoise Deepseek ait fait son chemin ce mois-ci dans la course pour le modèle de fondation gagnant.

Bien que le marché boursier ait eu le vent du modèle de grande langue puissant mais efficace lundi, envoyant le stock de Nvidia, Deepseek a été sur le radar des chercheurs et développeurs de l’IA depuis qu’il a publié son premier modèle, V2, en mai.

Mais la performance de la V3, publiée en décembre, est ce qui a fait que les développeurs de l’IA s’asseyent et en prennent note. Lorsque R1, le modèle de raisonnement de l’entreprise, qui rivalise avec l’O1 d’OpenAI, a été publié en janvier, la demande de H200 de Nvidia a commencé à grimper.

« Le lancement de Deepseek R1 a considérablement accéléré la demande de H200 », a déclaré Robert Brooks, membre de l’équipe fondatrice et vice-président des revenus du fournisseur de cloud Lambda. « Nous avons constaté un intérêt si fort que les entreprises préparaient de grands blocs de la capacité H200 de Lambda avant même la disponibilité du public. »

Les modèles de Deepseek sont open source, ce qui signifie que les utilisateurs paient très peu pour les utiliser. Mais ils ont toujours besoin de matériel ou d’un service de cloud computing pour les utiliser à grande échelle.

Trading Insider a parlé à 10 fournisseurs de services cloud et d’inférence sur l’IA. Cinq ont signalé une augmentation rapide de la demande d’unités de traitement graphiques H200 de NVIDIA ce mois-ci.

Amazon Web Services et Coreweave ont refusé de commenter. Oracle, Google et Microsoft n’ont pas répondu aux demandes de commentaires.

Cette semaine, AWS, Microsoft, Google et Nvidia ont rendu les modèles Deepseek disponibles sur leurs différentes plateformes de développeur cloud et IA ou ont fourni des instructions aux utilisateurs pour le faire eux-mêmes.

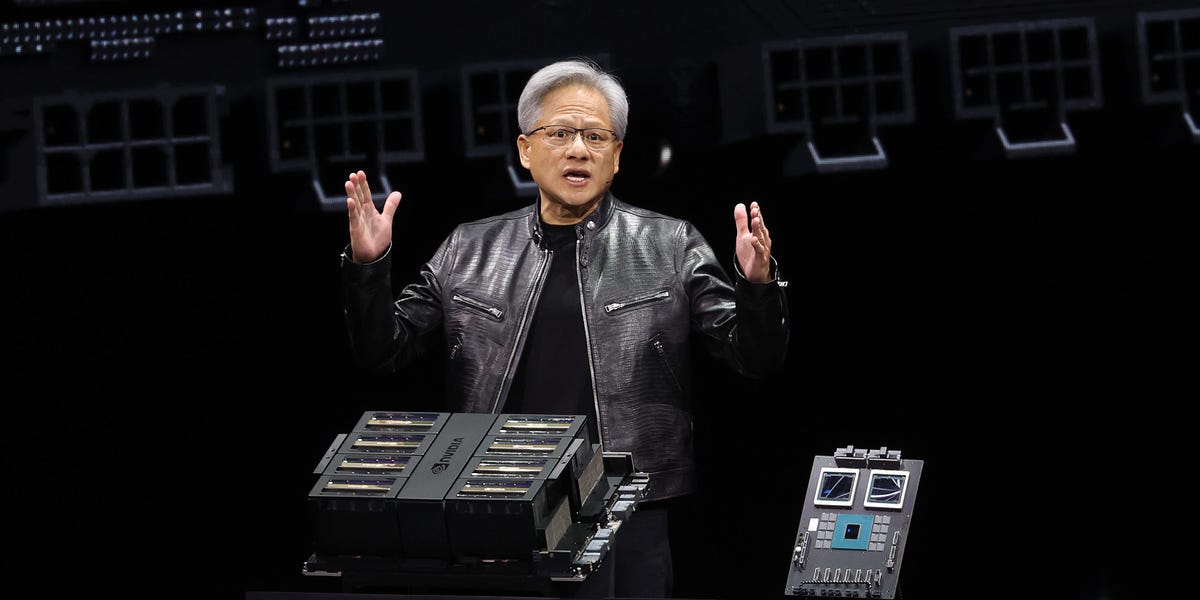

Nvidia a refusé de commenter, citant une période de calme avant sa libération des résultats le 26 février.

Les offres de cloud AI ont explosé au cours des deux dernières années, créant une série d’options au-delà des piliers du cloud computing telles que Microsoft Azure et AWS.

La demande provient d’une gamme de clients, notamment des startups, des chercheurs individuels et des entreprises multinationales massives.

« Nous avons entendu parler d’une demi-douzaine des 50 plus grandes entreprises du monde », a déclaré à BI Tuhin Srivastava, cofondateur du fournisseur d’inférence Baseten. « Je n’exagère vraiment pas. »

Vendredi, les analystes de l’industrie des semi-conducteurs en semianalyse ont signalé des « effets tangibles » sur les prix de la capacité H100 et H200 sur le marché provenant de Deepseek.

Colette Kress, directrice financière de Nvidia, a déclaré que lors de l’appel des bénéfices de novembre de la société, que les ventes totales de GPU Nvidia H200 avaient atteint les « milliards à deux chiffres ».

Demande « exponentielle » pour NVIDIA H200S

Karl Mozurkewich et son équipe du fournisseur de cloud Valdi ont vu la demande H200 augmenter tout au long de janvier – et au début, ils ne savaient pas pourquoi.

L’équipe Valdi ne possède pas de jetons; Il acquiert la capacité des centres de données existants et vend cette capacité aux clients. La société ne connaît pas chaque cas d’utilisation pour chaque puce qu’elle rend accessible, mais elle a interrogé plusieurs clients H200, et tous voulaient que les puces fonctionnent en profondeur.

« Soudain, R1 a attiré l’attention de tout le monde – il a pris feu – puis cela est devenu exponentiel », a déclaré Mozurkewich.

Les entreprises américaines sont impatientes de profiter des performances du modèle de Deepseek et des innovations de raisonnement, mais la plupart ne souhaitent pas partager leurs données avec une entreprise chinoise. Cela signifie qu’ils peuvent utiliser une API offerte par une entreprise américaine ou exécuter le modèle sur leur propre matériel.

Étant donné que le modèle est open source, il peut être téléchargé et exécuté localement sans partager des données avec Deepseek.

Mozurkewich a déclaré que la plupart de la demande H200 de Valdi provenait des startups.

« Il semble que le marché réagisse à Deepseek en saisissant les meilleurs GPU disponibles pour les tests le plus rapidement possible », a-t-il déclaré, ajoutant: « Cela a du sens, car la plupart des GPU actuels de la plupart des entreprises continueront de travailler sur des tâches en cours. J’ai été alloué à. «

Bien que de nombreuses entreprises testent et expérimentent toujours, l’équipe Valdi constate des demandes à plus long terme de matériel supplémentaire, suggérant une augmentation de la demande qui pourrait durer au-delà du cycle de battage médiatique initial de Deepseek.

Lumière à puce, lourde de calcul

Le document de recherche de Deepseek indique que ses modèles ont été formés avec du matériel moins puissant que les modèles américains. Cette efficacité a effrayé le marché boursier.

Des sociétés comme Meta, Openai et Microsoft ont investi des milliards dans des infrastructures d’IA, avec des milliards d’autres en cours de route. Les investisseurs sont préoccupés par la question de savoir si toute cette capacité sera nécessaire. Deepseek a été créé avec moins de puces relativement faibles (bien que le nombre soit vivement débattu).

Mis à part les puces d’entraînement, en utilisant les modèles pour l’inférence est une tâche à forte intensité de calcul, selon les fournisseurs de cloud.

« Ce n’est pas léger et facile à courir », a déclaré Srivastava.

La taille d’un modèle est mesurée en paramètres. Plus de paramètres nécessitent plus de calcul. Les versions les plus puissantes des modèles de Deepseek ont 678 milliards de paramètres. Le GPT-4 d’OpenAI a 1,76 billion, tandis que le plus grand modèle de lama de Meta compte 405 milliards.

Srivastava a déclaré que la plupart des entreprises évitaient le modèle LLAMA de 405 milliards de paramètres s’ils pouvaient l’aider, car la version plus petite était beaucoup plus facile à exécuter. Deepseek propose également des versions plus petites, et même sa version la plus puissante est moins chère à gérer, ce qui a excité excitée avec les entreprises qui souhaitent utiliser le modèle complet, ont déclaré les fournisseurs de cloud.

Les puces H200 sont la seule puce NVIDIA largement disponible qui peut exécuter le modèle V3 de Deepseek dans sa forme complète sur un seul nœud (huit puces conçues pour fonctionner ensemble).

Vous pouvez également le répandre sur des GPU plus à faible puissance, mais cela nécessite plus d’expertise et laisse de la place à l’erreur. L’ajout de cette complexité ralentit presque inévitablement les performances, a déclaré Srivastava.

Les puces Blackwell de Nvidia pourront également gérer le modèle V3 complet dans un nœud, mais ces puces viennent de commencer à expédier cette année.

Avec la demande de demande, trouver suffisamment de puces pour exécuter V3 ou R1 à grande vitesse est difficile s’ils n’ont pas déjà été alloués.

Baseten ne possède pas de GPU; Il achète la capacité des centres de données qui le font, puis bricolent toutes les connexions logicielles pour que les modèles fonctionnent en douceur. Certains de ses clients ont leur propre matériel dans leurs propres centres de données mais embauchent Baseten pour optimiser les performances du modèle.

Ses clients apprécient particulièrement la vitesse d’inférence – la vitesse qui permet à une voix générée par l’IA de converser en temps réel, par exemple. Srivastava a déclaré que la capacité de Deepseek au prix de l’ouverture a changé la donne pour ses clients.

« Il semble que ce soit un point d’inflexion », a-t-il déclaré.

Vous avez un pourboire ou un aperçu à partager? Contacter Emma à ecosgro@businessinsider.com ou utilisez le signal d’application de messagerie sécurisé: 443-333-9088